“Building multimodal ai to expand human imagination and capabilities”. C’est la promesse de Lumalabs, qui nous offre une solution deux en un ! L’application Luma AI est un scanner 3D, accessible depuis un simple smartphone. Luma Génie, pour sa part, prend place au sein des innombrables IA génératives, produisant en quelques secondes des objets 3D. Cet article ne traite que du premier, de Luma AI, la solution pour scanner des objets réels.

Disponibilité sur mobile : une application est disponible sous iOS et iPad OS, sur iPhone XR et plus (sous iOS 17) et sur iPad sous iPadOS 17.

Pour les propriétaires de smartphones sous Android, aucune application n’est disponible, ce que n’empêche d’avoir recours aux services de Luma via le navigateur Web du terminal.

Disponibilité via le web : Luma et Genie sont accessibles depuis n’importe quel appareil, via un navigateur Web.

Tarif : Luma est aujourd’hui disponible gratuitement, mais il y a fort à parier que dès lors que la solution sera encore plus complète et performante, des formules commerciales apparaîtront.

Compléments : pas un complément, mais deux ! D’abord une API est disponible pour les développeurs qui souhaitent accéder au maillage, améliorer le cycle de production et cette dernière. https://lumalabs.ai/luma-api

Et comme toutes les bonnes choses ont une fin, c’est ici qu’il faut un petit budget pour accéder à l’API, actuellement un dollar par modèle.

Luma propose aussi une bibliothèque web, pour rendre accessible vos scans depuis une simple page web. Le tout se fait via une technologie dont les adeptes de l’immersive learning sont au fait, le WebGL. La suite est par ici : https://lumalabs.ai/luma-web-library

En vous lançant dans le scan 3D, vous allez rencontrer une technologie à ne pas confondre avec les célèbres jouets, oui on vous parle bien de NeRF, avec cette orthographe précise !

Après consultation de notre stagiaire perpétuel, le bien nommé ChatGPT, nous découvrons que la technologie NeRF, acronyme de Neural Radiance Fields, est une méthode de modélisation et de rendu 3D qui utilise des réseaux de neurones profonds pour synthétiser des images photoréalistes. Cette approche permet de créer des représentations 3D détaillées d’une scène à partir d’un ensemble limité de photographies prises sous différents angles.

Les avantages de NeRF incluent la capacité de générer des images extrêmement réalistes avec des effets de lumière complexes tels que les ombres douces, les reflets et la translucidité.

On commence avec l’application Luma, donc le propos ici ne s’adresse qu’aux possesseurs d’iPhone ou d’iPad. On l’a déjà dit, l’accès est gratuit. Sa simplicité est désarmante, on vous laisse en juger ci-dessous, où vous trouverez le process décomposé en 5 étapes, suivi d’un tuto en vidéo.

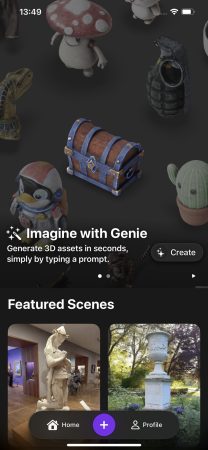

Étape 1 : Au démarrage l’application donne accès aux fonctionnalités de Scan (Luma.AI) et de Génération (Genie).

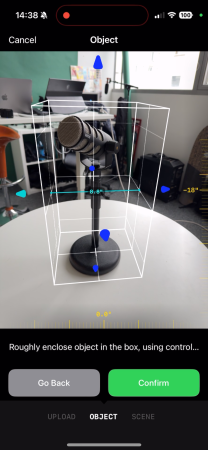

Étape 2 : Calibrage de la zone qui contiendra l’objet à scanner.

Étape 3 : Un volume englobe l’objet. Un redimensionnement peut être réalisé pour un scan optimal.

Étape 4 : L’intérêt de l’application réside dans la présence de guides. Ces chemins de fer apparaissent en haut, au milieu et au bas de l’objet.

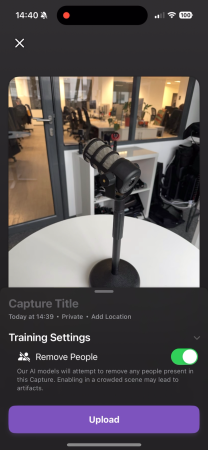

Étape 5 : Il ne reste plus qu’à expédier le scan pour un rendu, avec la possibilité de retirer les personnes présentes au moment de la captation.

Étape 6 : Le résultat peut être exploité sous la forme d’une vidéo, ou téléchargé dans différents formats 3D (gltf, obj,…) pour des ajustements et une exploitation dans des environnements qui le permettent.

Luma App n’existe pas pour Android. Cependant, il existe une solution, moins optimale certes, mais qui fonctionne tout aussi bien. Procédez de la plus simple des façons, en enregistrant une vidéo. Ayez à l’esprit que si vous aviez l’application sur votre smartphone, 3 guides ayant l’aspect de chemins de fer vous seraient proposés pour une captation efficace. Le premier au sommet, le second à mi-hauteur et le dernier à la base de l’objet scanné. Vous devez les suivre, les compléter avant de procéder au rendu. Sous Android, faites donc comme si ces chemins de fer vous étaient visibles. Voyez le tuto présent au sein de cette page pour plus de précisions.

La courte vidéo ci-dessous vous propose de suivre la démonstration qui vise à produire un objet 3D en quelques minutes, puis de l’exporter pour l’intégrer dans un outil auteur d’immersive learning, ici Sphere de Speedernet.

L’évaluation ci-dessous ne concerne que l’usage fait de cette solution par un formateur, sans que celui-ci n’ait besoin de compétences tierces.

Simplicité d’utilisation : ★★★★☆

Qualité de la production: ★★★☆☆

Facilité d’exploitation du résultat : ★★★★☆

Pertinence pour la production pédagogique : ★★★★☆

Tarif : ★★★★★ (gratuit pour l’instant)

Luma a peu de défauts, mais elle est encore loin d’être parfaite. Sans parler de ce que l’on peut faire en exploitant les fichiers 3D (gltf, obj, etc), on observe les défauts de rendu à l’œil nu. Est-ce que cela signifie que Luma n’est pas exploitable, évidemment non. En apportant un soin tout particulier au scan, en assurant de bonnes conditions de luminosité, le rendu ne devrait en être que meilleur.

A ce jour, les objets scannés sont utilisables. Ils vont parfois nécessiter des retouches, et c’est là qu’il vous faut les compétences 3D. C’est donc ici que se situe ce que nous percevons soit comme une limite, soit comme une opportunité pour les learning managers, les concepteurs pédagogiques, qui en faisant évoluer leurs compétences ouvrent grand les portes de la magie de la 3D.

Grâce à Luma, la modélisation 3D est désormais possible et accessible à tous et toutes.

Formateur vidéomobile, podcast, narration, IA